【書評】「21Lessons」 サピエンス全史の作者が明らかにする21世紀の思考法 〜トリアージと変則トロッコ問題〜

こちらの本を参考にしながら書かせていただきました。

[rakuten:book:19763308:detail]

某ギャグ漫画は関係ない

自粛期間にかまけてニュースサイトを流し見ていると、ある言葉が目に入った。

「トリアージ」

「ハルシオン・ランチ」ではトリアゾ推しだった私が、何か意味的につながりがあるのかと調べてみたところ、

「トリアージ(toriage)」

・・・大事故・災害などで同時に多数の患者が出た時に、手当ての緊急度に従って優先順をつけること。

とあり、全く関係ないことを悟った。

なんだ、吐瀉系ギャグマンガとはなんの関係もないのか…そう思いブラウザバックしようとすると、

「命の優先順位」という言葉が続いていることに気づく。

これは、一体誰が決めるのか。

決めた人が唯一、責任を負うのか。

判断基準はどうなるのか。

その記事は、多くの解き明かすことが難しい問題を提起して締め括られていた。

「命の優先順位」。この無理難題を考える倫理学上の問題がある。

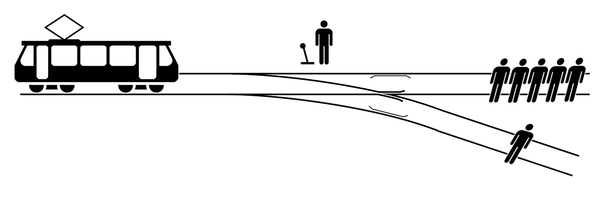

「トロッコ問題」

まず前提として、以下のようなトラブル (a) が発生したものとする。

(a) 線路を走っていたトロッコの制御が不能になった。このままでは前方で作業中だった5人が猛スピードのトロッコに避ける間もなく轢き殺されてしまう。

そしてA氏が以下の状況に置かれているものとする。

(1) この時たまたまA氏は線路の分岐器のすぐ側にいた。A氏がトロッコの進路を切り替えれば5人は確実に助かる。しかしその別路線でもB氏が1人で作業しており、5人の代わりにB氏がトロッコに轢かれて確実に死ぬ。A氏はトロッコを別路線に引き込むべきか?

なお、A氏は上述の手段以外では助けることができないものとする。また法的な責任は問われず、道徳的な見解だけが問題にされている。あなたは道徳的に見て「許される」あるいは「許されない」で答えよ、という課題である。

つまり単純化すれば「5人を助ける為に他の1人を殺してもよいか」という問題である。功利主義に基づくなら一人を犠牲にして五人を助けるべきである。しかし義務論に従えば、誰かを他の目的のために利用すべきではなく、何もするべきではない。

Wikipediaより出典

トロッコ問題はまさに、命をいかに扱うかという問題に、一貫して合理的な答えがないことを示している。

命は平等だと考えつつも、自らが手を加えて人に死を与えてしまうことを嫌う人は当然ながら多くいる。

死刑執行のボタンが複数人で押す仕様になっているのもこういった心理からだ。

だが実は、トロッコ問題が現実に与えてきた影響は、軽微だったとも言わざるを得ない。

人間は突然の危機に際しては大抵、情動と本能に頼りがちだからである。

(私の親は車を少し擦った時[突然の危機]、情動と本能に従ってそのまま進み、もっと傷を広げたことがある。)

また、「そもそもこんな問題が起こることは稀だから…」と目を背けそうになるが、

もし人間がこの問題から目を背けても、

私たち人間に大きな恩恵を与えてくれるAIが新たなトロッコ問題に直面すると考えられている。

彼らは、人間よりも多くのデータを持ち、人間よりも早い判断が可能だからだ。

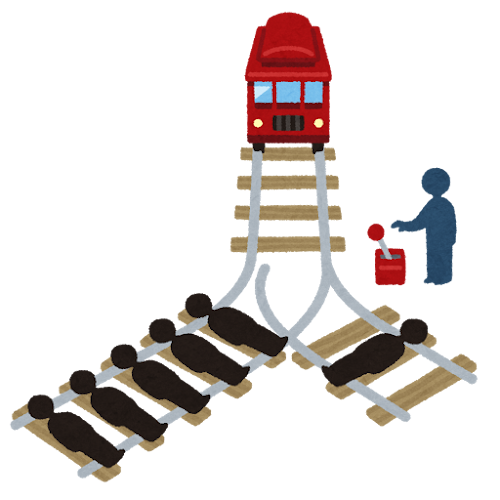

自動運転技術が直面する「トロッコ問題」と哲学的な車

人間の多くがAIにデータを提供し、起きる時間から好みの異性まで、アルゴリズムが決める時代に突入している。

腕時計型のデバイスが出したアラートが、重大な病気を発見することにつながったニュースは記憶に新しい。

しかしそれでも、多くの人は、「アルゴリズムが人間のための重要な決定を下すのはまだ難しい」と考えている。

SF映画に多くあるように、アルゴリズムやそれを利用するロボットたちは、とてつもなく合理的で、倫理観が欠如しているように捉えられているからだ。

(「エクス・マキナ」みたいに男心めっちゃ理解するようになる女性型ロボットが出るものもあるけど…。)

とはいえ、「21lessons」の作者ユヴァル・ノア・ハラリは、人間よりも俄然、AIが倫理問題を考える場が増えてゆくことを示唆している。

本文から引用してみよう。

たとえば、

自動運転車の目の前に、2人の子供がボールを追いかけて跳び出してきたとしよう。

自動車を運転しているアルゴリズムは電光石火の計算に基づき、

この2人の子供をはねるのを避けるには、急ハンドルを切って反対車線に逸れ、

近づいてくるトラックと衝突する危険を冒すしかないと結論する。

その場合、アルゴリズムの計算では、自動車の所有者(後部座席で眠りこけている)が

命を落とす可能性が70%ある。

アルゴリズムはどうするべきか?

上記のように、自動運転という一般化されつつあるものを通して、AIは現代のトロッコ問題に直面している。

人間と違い、アルゴリズムはストレスによって情動的に判断することはなく、

しっかりと考え抜かれた数値や統計による倫理プログラムと最高の運転技術をもって、

この課題に取り組む。

(作者はこの自動運転車の状態を「ミハエル・シューマッハとイマヌエル・カントのチーム」と称している)

カスタムする利他主義と利己主義

だが、先ほどの問題で子供を轢くにしろ、所有者を犠牲にするにしろ、どちらを倫理プログラムに書き込んでおくのか。

千年以上も哲学者たちが考え続けて、まだ答えの出ていない問題をそんなにあっさりと数値化できるだろうか。

車のメーカー次第だろうが、

メーカーはもしかすると、その事故の瞬間の二択の判断をランダムにするかもしれない。

ただ、そうした場合、50%の確率で自分を見殺しにするかもしれない車に身を預けようとする人間はどれほどいるだろう。

自分の哲学観と合わない選択をする可能性のある車は、あまり好まれないかもしれない。

そこでユヴァルは、

「車のメーカーはその哲学的判断をあっさり市場に委ねるかもしれない」と書いている。(もちろん、皮肉で)

・より大きな善のために所有者を見捨ててでも子供たちを救う

「利他主義」バージョン

・子供の命を奪うことになっても所有者を護る

「利己主義」バージョン

の二種の車種を販売するのではないか。

もし市場に「利己主義」バージョンが溢れても、メーカーは非難できない。

選んだのは消費者の倫理観であり、顧客は常に正しいのだから。

自身にも見えない情動、「利己主義」な人間性

さらに2015年に行われた先駆的な研究についても触れられている。

その研究では

先ほどのような自動運転車のトロッコ問題において、

多くの参加者が「自動車は所有者の命を奪うという代償を払ってさえ、歩行者を助けるべき」だと述べた。

選ばれたのは「利他主義」バージョンでした。

しかし、「もし自分が購入するなら、この車を選ぶか?」と質問された時は、多くの回答者が「ノー」と答えた。

自分が乗るなら、「利己主義」バージョンでした。

この研究をもとにトリアージに話を戻すと、

より多くの人がより大きな善によって、犠牲を厭わない判断を下すべきだと捉えることが考えられる。

しかし、自分がより重篤な患者のために病院のベッドを明け渡すように言われた時、

「嫌ならば『ノー』と言ってくれればいいんですよ」と言われた時、

一体何人の人が、功利主義に則って判断できるだろう。

本は考えるきっかけをくれる

選択する際に、常に自分の倫理観が使えるわけではない。自動運転車の問題のように、後ろで眠りこけているうちに誰かによって判断が行われていることもあると思う。

しかし、自分の中で自分ごととして課題を捉えるからこそ、奪われないものもあると感じている。「21Lessons」は自分の生き方を問う思考のきっかけとして、たくさんのものを与えてくれた。(それだけに読むのめっちゃ大変だけど)

自分と向き合う時間がある方は、ぜひ手にとって欲しいと思う。

[rakuten:book:19763308:detail]